Facebook cambia su moderación de contenidos

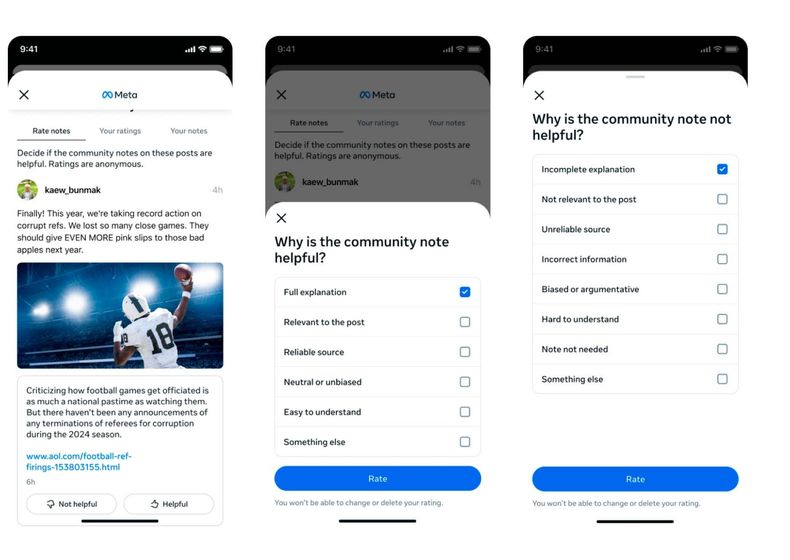

El 7 de abril, Meta puso fin oficialmente a su acuerdo con verificadores independientes en Estados Unidos y comenzó a implementar la función “Notas de la Comunidad” en Facebook, Instagram y Threads.

El nuevo modelo no contempla sanciones sobre los contenidos señalados. En la práctica, las personas titulares de cuentas pueden registrarse voluntariamente para contribuir, replicando el enfoque de la red X. No obstante, durante esta primera etapa las notas no son públicas.

Aunque Meta es enfática respecto de que las “Notas de la Comunidad” solo se implementan en Estados Unidos en carácter de prueba, el cambio en la estrategia de moderación de contenidos ya tiene efectos tangibles en América Latina.

Como sostiene la especialista en derechos y tecnología Carolina Botero, consultada para esta nota: “Una red social con alcance global tiene impactos fuera de esas fronteras y su expansión directa será cuestión de tiempo”, plantea.

El caso de Ecuador es paradigmático: este fue el primer país de la región en celebrar elecciones luego de los anuncios de Meta. Allí la empresa “mantuvo formalmente los convenios con fact-checkers como Ecuador Chequea, pero no reaccionó frente a los informes. No hubo etiquetado ni moderación de contenidos, a diferencia de años anteriores”, sostuvo Gustavo Gómez, director ejecutivo de OBSERVACOM.

En Perú también hay preocupación sobre el impacto que puede tener el cambio de reglas de Meta para las elecciones generales previstas para abril de 2026.

Las autoridades electorales instaron a Meta, X y TikTok a comprometerse para abordar la desinformación, fiscalizar la inversión de la publicidad electoral y la verificación de cuentas de organizaciones.

Desafíos para la regulación latinoamericana

El giro reciente de Meta habilita nuevas discusiones regulatorias en América Latina. Si bien las reglas de moderación comunitaria aún no se aplican en la región, su adopción en Estados Unidos reconfigura el escenario internacional. Para los especialistas consultados, este contexto abre una oportunidad para debatir marcos normativos que incorporen estándares de derechos humanos y respondan a las particularidades institucionales y políticas de la región.

Convocado para esta nota, Joan Barata, especialista en libertad de expresión y regulación de medios, plantea que la autorregulación empresarial, en su forma actual, no garantiza la protección de derechos, al tiempo que rechaza una regulación estatal que pueda derivar en prácticas autoritarias o usos partidarios.

La experta propone, en cambio, avanzar hacia soluciones sistémicas que establezcan obligaciones para las empresas, como transparencia, rendición de cuentas y mecanismos de apelación. Así, la regulación no debe centrarse en aquello que se publica, sino en cómo se toman las decisiones que impactan en la circulación de información.

Javier Pallero, experto en políticas e incidencia, sostiene que el contexto político contemporáneo exige repensar el modo en que se formula la agenda. Frente al desgaste del enfoque clásico de derechos humanos, propone recuperar la idea de soberanía tecnológica como entrada estratégica al debate para generar consensos más amplios sin renunciar a la protección de derechos fundamentales y evitar medidas regresivas como el bloqueo de las plataformas.

Para Botero, frente al bloqueo que el gobierno de Trump hará ante cualquier intención regulatoria por parte de la región, emergerán iniciativas específicas que alcancen a las plataformas. “Más que leyes que regulen las redes sociales, lo que veremos serán disposiciones regulatorias para las redes sociales en reformas electorales, mediáticas, de violencia de género”, advierte.

Del FOB a las notas de la comunidad

Meta demostró una notable capacidad para adaptarse a los cambios políticos, a las presiones de actores del mercado mediático y a las demandas de la sociedad. Su agilidad para reaccionar rápidamente a situaciones que ponen en riesgo su imagen pública y la legitimidad de sus mecanismos de funcionamiento fue clave para la consolidación de su modelo de negocio.

Esta dinámica se evidenció primero con la creación del Facebook Oversight Board (FOB) tras el escándalo de Cambridge Analytica en 2017, como respuesta directa a las presiones de gobiernos, empresas mediáticas y de la sociedad civil que reclamaban una mayor regulación estatal.

En sintonía con principios democráticos, en noviembre de 2018 la empresa anunció la creación del FOB, un cuerpo independiente de revisión final de sus decisiones de moderación de contenidos, que recogía la recomendación del ex relator de Libertad de Expresión de Naciones Unidas David Kaye.

Aún cuando se trata de un mecanismo creado y financiado por la empresa, el FOB se destacó por la idoneidad de sus integrantes y porque resultó exitoso al introducir estándares de derechos humanos y contextos locales en el análisis de casos. No obstante, sus efectos fueron limitados por la cantidad de incidentes que analiza, por el hecho de que las decisiones no sean vinculantes y por su impacto para la elaboración de políticas de moderación de Meta.

“El Board fue útil como mecanismo simbólico, pero sin poder real ni transparencia plena en la interpretación que Meta hace de sus propias reglas”, apuntó Pallero.

En un entorno moldeado por intereses privados, los límites del FOB y el retiro de Meta de la moderación de contenidos, en sintonía con los cambios de “vientos políticos”, vuelven necesario pensar estrategias para incidir en la búsqueda de mecanismos eficaces para el ejercicio de derechos digitales.

LetraP